So entlarvt eine KI zur Gesichtserkennung massenhafte Betrugsversuche

Seit einigen Wochen verfolgen mich asiatische Schönheiten. Nicht diese brüsken, dürftig bekleideten Damen, die der Spamfilter ohnehin aussortiert. Die vermeintlichen Damen sind stets züchtig gekleidet und zumeist an die 20 Jahre jünger. Sie schreiben mir auf Instagram und auf WhatsApp per direkter Nachricht subtile Botschaften. „Warum wirst Du mir dauernd hier auf Insta empfohlen?“, fragt eine Amra auf Englisch. „Hallo, bist Du der Typ aus dem Business Meeting in Tampa?“, erkundigt sich eine Catalina aus Florida. „Ich habe Dein Landschaftsfoto gesehen, tolles Bild!“, findet eine Lee aus London.

Nun werden meine direkten Nachrichten auf Instagram in einem Ordner „Nachrichtenanfragen“ abgelegt, den ich selten aufsuche. Benachrichtigungen dazu sind aus, so herrschte lange Zeit Ruhe im Karton. Bei WhatsApp werden solche Botschaften normalerweise von mir gemeldet und die Absender blockiert.

Doch neugierig, wie ich bin, bin ich dann doch mal auf die Anfragen auf Instagram zum Schein eingegangen. Worauf war die Masche aus?

Quatschen mit Amra, Catalina und Lee

So quatschte ich über Tage mit Amra, Catalina und Lee, schnell kamen ein paar weitere vermeintliche Damen hinzu, die mir zuletzt ihren Kontakt angeboten hatten. Ich entdeckte wunderbare Lofts in Manhattan und Restaurants in Malaysia, fotografiert wurden edle Mahlzeiten und noch öfter das eigene Spiegelbild.

Man verliert übrigens schnell den Überblick, wer von denen welchen Beruf hat und ob man schon gefragt hat, aus welcher Stadt sie kommt. Fragt man in so einem Chat ein zweites Mal nach der Herkunft, so deutet der Tonfall der Antwort auf Entrüstung wegen des Mangels an Aufmerksamkeit, für euch ausprobiert.

Erstaunlicherweise verfügten alle angeblichen Damen ausweislich ihrer Fotos über einen gewissen Reichtum. Davon zeugten Bilder tollen Essens in teuren Restaurants, Gucci- und Dior-Handtaschen und ein Besuch auf der Ferrari-Messe in Abu Dhabi. Selten zeigten die Damen viel Haut, das wäre zu profan. Höchstens mal etwas Fitnessstudio. Und so gut wie immer reagierten die Damen fast beleidigt, wenn man nicht sofort auf eine Nachricht antwortete, Zeitzonen hin oder her.

Schneller Wechsel von Instagram auf WhatsApp

Erst vermutete ich künstliche Intelligenz im Einsatz – als ich bemerkte, dass die Antworten meine Rechtschreibfehler imitierten. Dann verquatschte sich eine der Angreiferinnen und fragte übermütig, was ich denn eigentlich dauernd mit ihren Freundinnen zu besprechen hätte? Häufig wollten die Damen schnell auf WhatsApp wechseln, das wäre ja irgendwie persönlicher. Nur auf meine listige Frage, ob wir mal telefonieren möchten, reagierte keine der Befragten wie gewünscht.

Zweimal lenkten die Gesprächspartnerinnen das Thema auf Kryptowährungen, die eine fragte rundheraus nach einer „kleinen“ Investition von 500 Dollar, ihr Onkel sei Banker und bekomme häufiger mal einen guten Tipp; Sie wissen schon, der Short-Selling-Handel. Da glaubte ich endlich zu wissen, worauf die Angreiferinnen letztlich aus waren. Doch erstaunlicherweise waren die anderen Damen nicht an meinen Kryptowährungskenntnissen interessiert, als nun ich die Gespräche zum Test darauf zu lenken versuchte.

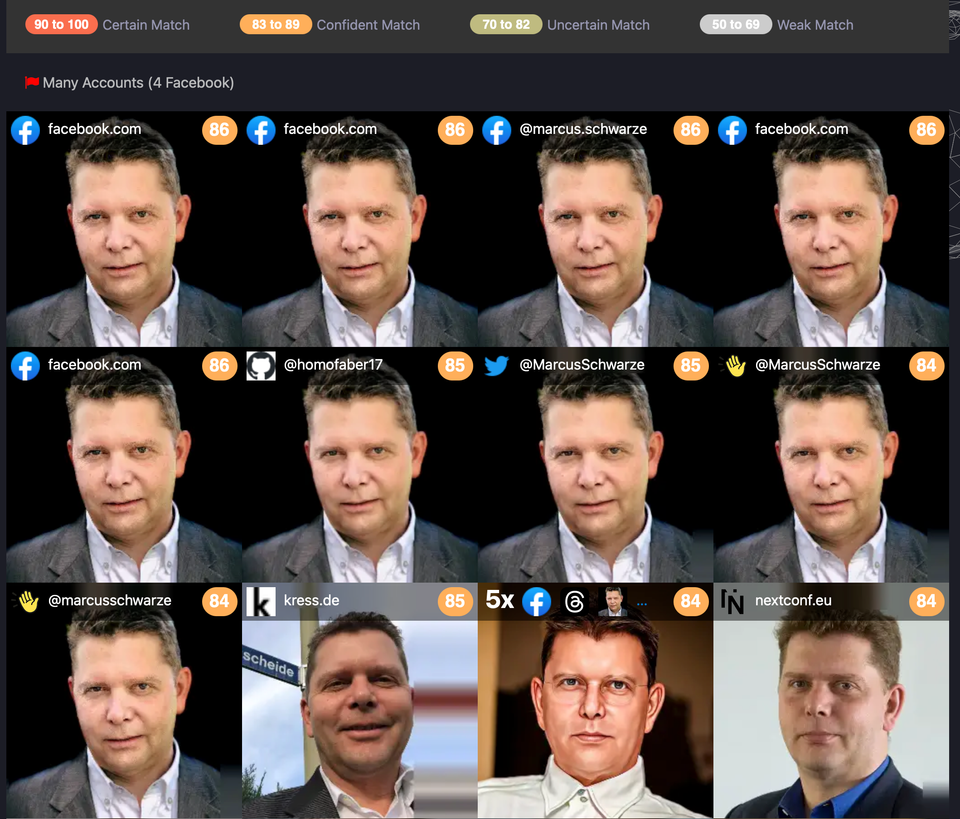

Alle zwölf Damen waren Fake

Den wahren Grund für die massenhaften Kontaktanbahnungen habe ich am Ende nicht herausgefunden. Nur dass alle zwölf Damen Fake-Profile waren und sind, das hat mir eine Maschine der künstlichen Intelligenz (KI) bewiesen: Bei facecheck.id kann man ein Porträt einer Person hochladen, der Dienst findet dann per Gesichtserkennung ähnlich aussehende Social-Media-Profile dazu. Gesucht wird dabei nicht nach der identischen Bilddatei wie bei Google Bilder, sondern nach biometrischen Merkmalen, die die KI in einer Datenbank gespeichert hat.

Und siehe da: Plötzlich heißt die Gucci-Catalina auch mal Jini und wohnt statt in Florida in Los Angeles; mit dem gleichen Gesicht gibt es 17 LinkedIn- und zehn Twitter-Accounts mit unterschiedlichen Namen. Die Kryptowährungs-Amra ist mit demselben Bild auf Twitter mal als Phyllis, Luca und Huang-Deng unterwegs, gilt auch dort ausweislich ihrer Posts als Fachfrau für Kryptokohle. Nur Kommentare von Freundinnen oder Freunden findet man dann selten, Schönheit macht wohl einsam. Den prominentesten Chat erlebte ich mit Erin, die auch schon mal Celia heißt und namens einer Modemarke aus Korea mit einem Account 103.000 Follower zählt.

Vertrauen erschleichen, Kompromat erlangen

Was hat es letztlich mit solchem Scam, Betrug also, auf sich? Ich kann nur vermuten: Es geht darum, Vertrauen aufzubauen und zu erschleichen. Möglicherweise wollte jemand irgendwann kompromittierende Antworten von mir provozieren, um sie anschließend für eine Erpressung zu verwenden. Der gesunde Menschenverstand kann bei so viel Schönheiten schließlich schon mal verloren gehen.

Dass es sich um eine konzertierte Aktion handelte, beweist ein anderer Umstand: Als ich zwei der Damen mit den gefundenen weiteren Social-Media-Profilen konfrontierte, reagierte die eine zickig (oder bockig?), „Ich bin ich“, und die andere blockierte mich sofort. Fortan reagiertefür eine Weile die ganze Bande nicht mehr. Offenbar waren die falschen Freundinnen auch untereinander gut vernetzt.

Persönlichkeitsrechte?

Ob der Dienst Facecheck.id in Europa zulässig ist oder nach Verabschiedung des europäischen KI-Acts noch ist, steht auf einem anderen Blatt. „Nur für Lernzwecke“ schreibt der Betreiber Sentient Labs aus Indonesien. Man rühmte sich zuletzt, 400.000 Fotos und Profile von Heiratsschwindlern und Liebesbetrügern erfasst zu haben. Insgesamt soll die Maschine 550 Millionen Bilder kennen. Wie das mit dem Persönlichkeitsrecht oder dem Verwertungsrecht von Fotos einhergeht, ist schleierhaft. Und warum es von Unternehmenschef Lee Chong offenbar kein öffentliches Bild gibt, wundert auch ein wenig. Eine Homepage der Firma fand ich nicht.

Eine weit größere Gesichterdatenbank namens Clearview AI mit 30 Milliarden Bildern wurde laut einem Bericht der „New York Times“ mittlerweile in mehreren europäischen Ländern sowie in Kanada und Australien verboten. Öffentlich zugänglich ist der Dienst nicht, Strafverfolgungsbehörden in den USA nutzen ihn – unter anderem auch in Dänemark, Finnland und Frankreich. Auch Interpol soll den Dienst 320-mal eingesetzt haben. In Deutschland hat der Hamburger Datenschutzbeauftragte den Dienst als Verstoß gegen die Datenschutzgrundverordnung eingeschätzt. Italien verhängte eine Geldstraße von 20 Millionen Euro. Zuletzt machte das Unternehmen mit einem Einsatz im russischen Krieg in der Ukraine von sich reden: Ukrainische Militärs identifizierten damit Tote und russische Überläufer.

Gleiche Bilder, gleicher Film

Gerade hat wieder eine unbekannte Linda elf meiner Bilder auf Instagram durchgelikt, es geht schon wieder los. Ihre eigenen Fotos deuten auf ein sorgenfreies Leben. Komisch nur, die angebliche Dame ähnelt laut Gesichterkennungs-KI zum Verwechseln dem Model Veronika Cereda aus Kiew. Und merkwürdig – bei der prominenteren, augenscheinlich authentischen Dame mit Zehntausenden Fans taucht das gleiche Bild auf einem Schimmel reitend durchs Wasser auf. Eine Aufnahme von Frau Sereda aus Dubai im mintgrünen Kostüm mit weißer Handtasche kann Linda ebenso vorweisen. Und sogar das Video von ihr unter Wasser mit blauen Flossen gibt es in beiden Profilen.

Zufälle gibt’s.

Wenn Sie die Fake-Entlarvung einmal selbst ausprobieren möchten: Ich folge nun bis auf Weiteres mehreren dieser Fake-Damen auf Insta. Meine Followings sind öffentlich. Und wundern Sie sich nicht über manche Followings, die anders als die hier genannten Konten niedere Instinkte ansprechen. Eine gewisse Sarah Jordan ist ganz offen ein Fake mit sehr freizügigen Bildern. Der Account ist komplett KI-generiert. „Made in Australia“.

Das Konto zählt 377.000 Follower.

- Zum Schutz der realen Personen, deren Bilder hier offensichtlich für Betrugsversuche missbraucht werden, habe ich in diesem Beitrag auf Screenshots der von facecheck.id gefundenen Fake-Profile verzichtet; stattdessen lud ich dort ein Bild von mir selbst hoch und ließ die Maschine nach meinem Gesicht suchen.

Comments ()