So lässt sich jeder geschriebene Text zu einem lippensynchronen Video mit eigener Stimme vertonen

Das unglaubliche Tempo bei der künstlichen Intelligenz (KI) bringt dem Otto-Normal-Verbraucher und der Anna-Spezial-Verbraucherin Anwendungen, die früher Fachleute vorbehalten war. Diesen Text habe ich klassisch am Computer getippt. Das Video unten entstand daraus in der Maschine.

Und zwar, ohne dass ich den Text je eingesprochen habe. Die Stimme ist computergeneriert. Und die Lippenbewegungen im Video sind es ebenfalls.

Die Anwendung basiert auf ElevenLabs. Deren Sprachmodul erlaubt es, meine Stimme zu synthetisieren. Mindestens eine Minute von einem beliebigen Text spricht man vor, schon lässt sich die Stimme klonen.

Wenige Minuten der Stimme genügen

Wer mich kennt und in dem Video hört, dürfte mich an der Stimme halbwegs wiedererkennen. Dabei habe ich hier nur die „Instant“-Schnellversion des Stimme-Klonens angewendet. Ein besseres Modell erfordert mindestens dreißig Minuten Einsprechen eines ausführlichen beliebigen Textes. Dann gelingt das Stimme-Klonen genauer.

So habe ich einen länglichen Spiegel-Artikel vorgelesen, mich manchmal verhaspelt und von einem Amazon-Lieferanten stören lassen, egal: Ab Juli soll die stark verbesserte geklonte Stimme ausgeliefert werden, ich habe mich da in eine Schlange eingereiht. Wer weiß, wozu man das noch braucht.

Die Verknüpfung mit dem Standbild und die lippensynchrone Aussprache erfolgt dann über eine KI-App namens Heygen – oder hier: D-ID. Da lädt man sein Foto hoch, kopiert den Text dieses Beitrags hinein – schon spricht der virtuelle Marcus wie gewünscht, was hier steht.

Wer will, kann den vielleicht zu monotonen Ton aufpeppen. Gerade längere Texte können schnell langweilig klingen. Dann dreht man etwa an der Stellschraube „Stabilität“, variiert die Betonung. Es gibt längere Pausen, wo die KI das für empfehlenswert hält, die Stimme geht mal hoch und runter.

Texte ohne Ähs und Genuschel

Auf der Strecke bleiben dabei Ähs und Genuschel, was ich mir schon wünsche. Auch überlange Pausen in einer normalen Aufnahme, weil vielleicht gerade eine Meldung auf dem Handy ablenkte, sind eliminiert.

In der Praxis muss man auf ein paar Besonderheiten bei Elevenlabs achten. So wird die Jahreszahl Zweitausenddreiundzwanzig in Ziffernschreibweise als 2023 ausgesprochen, englisch also, obwohl der Text in Deutsch ist. Ausgeschrieben funktioniert die Jahreszahl aber. Oder das Wort „bei“: Mein Instant-Sprachmodell hat das deutsche „bei“-Wort nicht richtig angelernt, also ersetze ich es im Text durch das englische „by“ mit b und Ypsilon.

Kleinigkeiten. Eine große Nummer wird aus diesen Experimenten, wenn man die weiteren Stellschrauben bedient: Der Unternehmenschef soll in der Monatsbotschaft auf Deutsch, Englisch, Schwedisch und Schweizerdeutsch die Mitarbeitenden ansprechen? Kein Problem: Die geschriebenen Texte lassen sich von DeepL schnell übersetzen. Elevenlabs generiert dann vier Sprachaufnahmen. Die werden lediglich noch mit Heygen und dem Foto des Herrn verknüpft – schon gelingt die weitgehend fehlerfreie Aussprache in den Fremdsprachen.

(Vorausgesetzt, man hat den Chef einmal halbwegs fehlerfrei einen beliebigen Text in der Fremdsprache einsprechen lassen.)

„Sound happier“ – der Text wirkt freundlicher

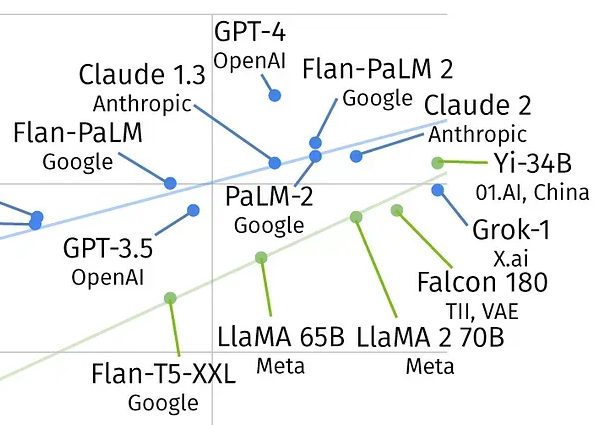

Und noch eine Funktion stellt Heygen bereit: Der schriftliche Text lässt sich inhaltlich sinnvoll kürzen oder verlängern. Er kann „professioneller“ oder „ansprechender“ umformuliert werden. „Sound happier“ ist womöglich ein anderer Wunsch an den Text. Klar, auch hier kommt wieder eine KI ins Spiel, in diesem Fall GPT.

Zur Verfügung stehen außerdem vorgegebene Stimmen – wie geschaffen für den wöchentlichen Firmenpodcast unabhängig von der Chefstimme. Für die Bahnansage ist vielleicht gerade ein donnernder „Arnold“ zeitgemäß, fürs Einstimmen auf schlechte Geschäftszahlen eher ein rücksichtsvoll klingender Antoni.

Man stelle sich fröhlichere Bahnansagen, verständlichere Chefansprachen, auf den Kern verkürzte Geschäftsberichte ohne Geschwafel vor.

Die Wirkung wird „echter“

Oder Nordkoreas Diktator Kim Jong-un, der nach seinem Ableben noch eine Weile zumindest Radioansprachen veröffentlichen lässt. Das lippensynchrone Abbild ist als Fälschung schnell enttarnt. Noch. Bei Heygen gibt es bereits zwei professionell fotografierte Personen, die Gestik miteinbeziehen und „echter“ wirken.

Vom Standbild als Vorlage zum Video einer älteren Rede als Grundlage ist es für die KI nur ein kleiner Kim.

Comments ()